Введение.

Сложность мира и жизни людей в современных условиях увеличивается: в 2026 г. общий объем перерабатываемой информации на планете составит 163 зеттабайта (1 зеттабайт= 1021 байт), на промышленность и производство приходится 60% этого объема данных, ежегодно объем данных возрастает на 30%, на жителя Земли приходится 2,5.108 байт в год. Этот информационный взрыв усложняет жизнь людей и приводит к большим информационным нагрузкам человека. Производство информации быстро нарастает, ее обработка существенно отстает от растущих объемов [1,2]. При этом информационные возможности человека не безграничны, сенсорные системы имеют физиологические ограничения по приему и переработке информации. Возникает серьезная проблема дальнейшего прогресса- адаптации человека в процессе информационной эволюции. Для этого нужно иметь меры этих возможностей и знать ограничения функциональных возможностей мозга и человека. Изучение человека, его мозга, поведения и психики – важнейшая задача науки для обеспечения прогресса технологий. В этих условиях представляет интерес изучение информационных характеристик сенсорных систем в аспектах: 1)роботизации, конструирования сенсоров для роботов, 2)оценок информационных характеристик человека для организации его деятельности; 3) определения предела информационных возможностей человека; 4)построения систем искусственного интеллекта, повышающих производительность труда. Максимальный объем восприятия информации определяет предел технологического развития человечества. Сейчас, чтобы нормально жить, нужно иметь специальность и знания на уровне высшего образования. Технологическое развитие страны требует растущего уровня знаний работников; за 16 лет (школа + вуз) можно получить приемлемый уровень специальных знаний в любой области. Но по мере технологического прогресса это время будет увеличиваться. Наступит момент, когда для освоения самых передовых технологий человеку потребуется время, сопоставимое с продолжительностью его жизни. Это и будет пределом технического прогресса человечества. Новые и высокие технологии основаны на моделировании работы мозга, для разработки систем искусственного интеллекта нужны знания организации мозга. Цель статьи: анализ основных результатов оценки сложности и информационных характеристик сенсорных систем человека, разработка инструментов количественного анализа информационных преобразований в анализаторах, разработка рекомендаций по эффективному использованию сенсорного восприятия.

1.Материалы исследований сенсорных систем человека

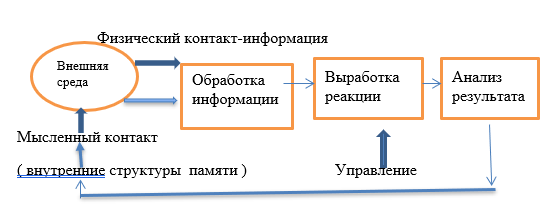

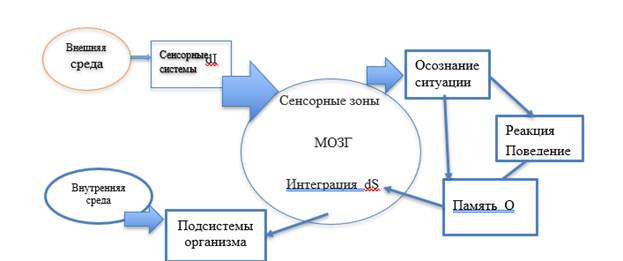

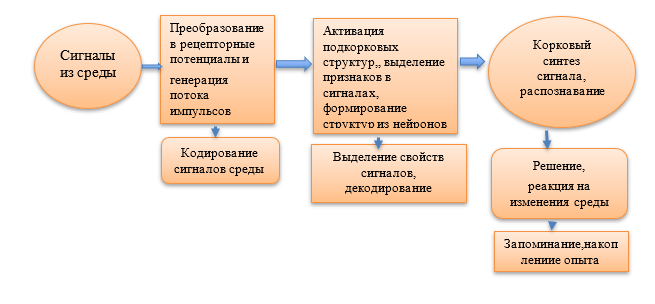

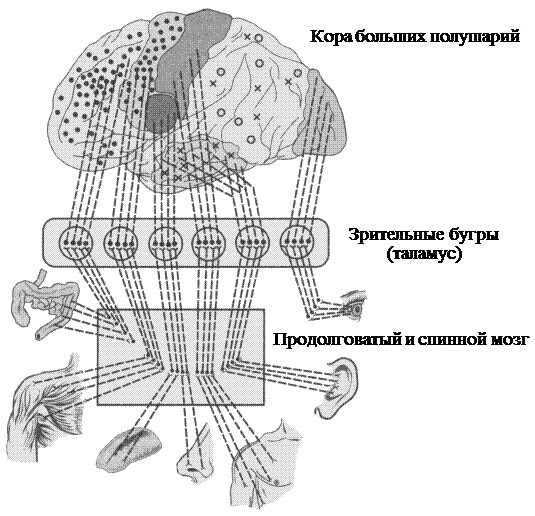

Сенсорные системы человека обеспечивают его связь с внешним миром и живучесть за счет постоянной адаптации к изменяющейся среде. Основные функции сенсорных систем (рис. 1): рецепция сигнала, преобразование рецепторного потенциала в импульсную активность проводящих путей, передача импульсов к подкорковым сенсорным ядрам, преобразование нервной активности в сенсорных ядрах на каждом уровне, анализ

Рисунок 1 – Общая схема функционирования мозга

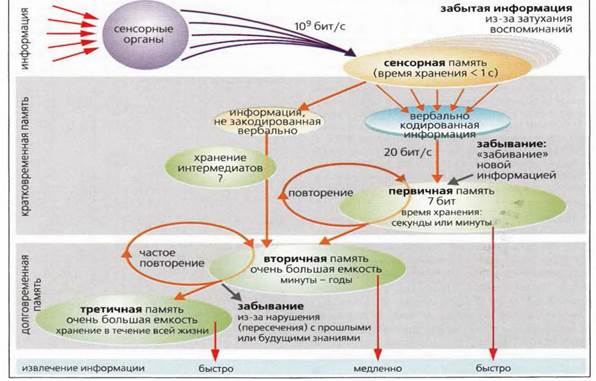

Сенсорные системы обеспечивают: формирование ощущений и оценку действующих стимулов, контроль процессов деятельности и контроль внутренних органов. Сенсорное восприятие включает следующие этапы: 1) действие раздражителя на периферические рецепторы; 2) преобразование энергии стимула в электрические сигналы — потенциалы действия, возникающие в первичном сенсорном нейроне; 3) последующую переработку передаваемых сигналов на всех иерархических уровнях сенсорной системы; 4) возникновение субъективной реакции на раздражитель, представляющей собой восприятие или внутреннее представительство действующего стимула в виде образов или словесных символов (рис. 2).

Рисунок 2-Механизмы преобразования сигналов в сенсорных системах человека

Сенсорные системы как процессоры обрабатывают информацию из среды параллельно, формируя многомерные структуры связей нейронов для накопления опыта и знаний о среде )рис. 3). Формируется негэнтропия, обуславливающая самоорганизацию и адаптацию организма к среде.

Рисунок 3- Общий план строения сенсорных систем человека

Основные информационные характеристики сенсорных систем: производительность, объем памяти, вычислительная мощность, сложность, предельные возможности обработки информации. Причем, эти характеристики можно рассматривать на микроуровне и на системном макроуровне (табл. 1).

Таблица 1- Показатели сенсорных систем

|

Микроуровень (физиология) |

Макроуровень(психология) |

|

Информационная емкость нейрона, отдела анализатора, анализатора, мозга |

Передаточная функция деятельности человека Запаздывание реакции |

|

Пропускная способность: отдела анализатора, нейронной сети |

Время реакции |

|

Разнообразие структурных и функциональных состояний, сложность |

Вычислительная мощность человека Потребляемая энергия Мыслительная активность |

|

Скорость обработки информации |

Производительность |

|

Диапазон импульсной активности нейронов |

Объем памяти |

Сенсорные системы имеют разные структуры, определяемые характеристикамми обрабатываемой информации (табл. 2, [2])

Таблица 2-Основные характеристики обработки информации в анализаторах

|

Вид анализатора |

Рецепторы |

Первое переключение |

Повторные переключения |

Проекционные области коры ЦНС |

|

Зрение |

Палочки и колбочки сетчатки |

Сетчатка глаза |

Таламус, верхнее четверохолмие |

Затылочные доли, поле 17 |

|

Слух |

Волосковые клетки улитки |

|

Мост, оливы, нижнее четверохолмие, таламус |

Поперечная височная извилина, поле 41 |

|

Осязание |

Кожа |

Продолговатый мозг |

Таламус |

Постцентральная извилина |

|

Равновесие |

Волосковые клетки вестибулярного аппарата |

Вестибулярные ядра |

Глазодвигательные ядра,ствол, спинной мозг ,мозжечок, таламус |

Постцентральная извилина |

|

Вкус |

Вкусовые почки языка |

Продолговатый мозг |

Таламус |

Постцентральная извилина |

|

Обоняние |

Биполярные клетки носовой пазухи |

Обонятельная луковица |

Пириформная кора |

Лимбическая система |

|

Боль |

Ноцицепторы кожи |

Задние рога спинного мозга |

Таламус, ретикулярная формация |

Постцентральная извилина, передняя поясная извилина |

Информационная емкость- максимальный объем информации, доступный для системы за определенный интервал времени, для человека это максимальный объем информации, который он может обработать за единицу времени. Информационная энтропия- это мера неопределенности некоторой системы, например, непредсказуемость появления сигнала определенного алфавита. Функциональная сложность определяется количеством операций, требуемых для реализации функций системы, преобразований входов в выходы, или объем ресурсов, используемых для решения определенных задач. Сложность системы можно охарактеризовать числом необходимых для ее описания битов, сложность растет с ростом числа элементов системы и ее беспорядка (энтропии )[3].

Предельная пропускная способность нейрона – 500-1000 импульсов в секунду. Общее число нейронов человеческого мозга достигает 100 млрд. структурных единиц [4], образуя вместе с периферийными отделами передачи информации сложнейшую многосвязную информационную сеть, называемую центральной нервной системой. Условия нормальной работы человека-оператора: 1) способность человека к восприятию = 10 сигналам в секунду; 2) большинство сенсомоторных реакций с участием тактильных, звуковых, зрительных внешних воздействий включает в себя латентный период времени (задержка) в диапазоне 0,09-0,22 с.; 3) для более сложных логических операций в диапазоне 0,52-0,64 с.; 4) комфортная скорость декодирования человеком информации – 2 бит\сек. Максимальная – 40 бит\сек (экстремальное значение 70 бит\сек); 5) предельно минимальные интервалы времени между сигналами, на которые возможна адекватная реакция оператора – 0,5 сек.

2.Методы исследования. Сложность: измерение и оценки

Сложность характеризует важную качественную особенность построения сложной системы, выражающую разнообразие ее элементов и связей и новизну конструкции и структуры , т.е.

сложность = разнообразие состояний + новизна элементов и структур

Применяемые нами для исследования сложности анализаторов комбинаторные и статистические методы дают возможность анализировать объективную сложность отделов анализатора и структур мозга, оценивать пропускную способность и их информационные характеристики. Разнообразие можно измерить количеством информации для описания состояний системы. Для большей полезности системы она должна иметь больше состояний, более полезный инструмент сложнее, он может выполнять несколько функций. Функциональная сложность, которую обычно и понимают под сложностью системы, также является сложностью описания, но не системы, а множества функций, которые она способна выполнять. Из принципа «необходимого разнообразия» У.Р.Эшби [1] следует, что управление не может быть оптимальным, если разнообразие управляющей системы меньше разнообразия подчинённой системы. Каждая система характеризуется структурой и функцией, структура фиксирует в статике элементы и их связи, функция- алгоритмы, правила действия, динамику работы элементов при решении задач [3]. Сложность системы можно охарактеризовать разнообразием ее состояний, чем больше состояний имеет система, тем она сложнее. Точнее, сложность - это логарифм числа ее состояний [4,5]:

Сложность С= к. lg (R) (1)

если R= 108 и к=1, то С= 8 хартли. Для оценок сложности применим десятичные логарифмы количества состояний- хартли. На этой основе можно оценивать структурную и функциональную сложность различных систем через их разнообразие состояний [6,7]. Структура из N элементов, соединенных по принципу «каждый с каждым» , будет иметь

S= N.(N-1)= (N2 – N ) связей (2)

т.е. число связей в такой структуре пропорционально квадрату числа элементов. Если каждый элемент имеет w связей с другими элементами, то число возможных конфигураций структур в такой сети равно [3]:

SR= N.W/2 (3)

Разнообразие функциональных состояний зависит от числа состояний элемента W и числа элементов N:

Ra = wN (4)

Если в сети 2 триггера, то R2=22= 4 состояния (00, 01,10, 11), если 3 триггера (N=3), то R3= 23=8 (000, 001, 011, 100, 101, 111, 010, 110) и т.д. Полное разнообразие сети из N элементов и S связей равно произведению [3] :

Rg= wN. vS (5),

где v- число возможных состояний связи ( при бинарных состояниях- включена- не включена- v=2). Например для сети с w= 8, N=100, V=2 и S= 50 Rc= 8100.250= 2,3.10105, что больше числа атомов в видимой Вселенной (1076). В этом многообразии состояний живых систем заключается “проклятье размерности”.

Обратимся к разнообразию структур и функций нервной системы. Элементы нервной системы- нейроны могут иметь независимо изменяющиеся пороги wп и веса wв, что даст формулу расчета общего разнообразия состояний сети из N элементов в виде [3,6]:

Rоб= wSR .wN (6)

Сенсорная система может одновременно менять структуру связей нейронов под воздействием внешних сигналов и находиться в одном из возможных функциональных состояний. Если i- индекс структуры системы, а j – индекс j-того функционального состояния, то вероятность нахождения сенсорной системы в j-ом функциональном и i-том структурном будет равна рij. Если эти состояния независимы, то реализуются соотношения:

Рij = рi.pj

SPij = 1 (7)

Pi= SS pij = SS pij

Неопределенность сложного события (i ,j) характеризуется энтропией:

Hcc = - ΣΣ pij.log pij (8)

Если все события равновероятны ( pi= 1/m, pj= 1/n), то неопределенность оценки состояний сенсорной системы максимальна, и Hmax= log mn, т.е. максимальная неопределенность системы равна сумме максимальных неопределенностей структуры и функции системы:

H max= Hстр + Hфунк = log m + log n (9)

Неопределенность системы характеризует ее стохастическое случайное поведение, которому противостоит определенность состояний, детерминизм, упорядоченность, т.е. организация. Чем выше организация системы, тем более упорядочены ее состояния, меньше неопределенность. Уровень относительной организации связан с текущей и максимальной энтропией формулой фон Ферстера [3]:

R= 1- H/Hmax (10)

В случае полностью детерминированных состояний системы Н=0 и R=1, при полной неопределенности H=Hmax и R=0. Меры организации Н и R можно применить для оценки сенсорных систем, учитывая их структурные и функциональные особенности. Для оценки уровня организации отдела анализатора по связям между клетками, при порогах нейронов и весах синапсов неизменными количество возможных состояний связей равно

Мсв= SR (wн)N (11)

где Wн- количество состояний нейрона отдела анализатора,

Считая, что любое из этих состояний равновероятно, рассчитаем максимальную неопределенность сети

Нmk = log SR + N.log wн (12)

Сеть нейронов отдела анализатора может часто использовать какую-то одну конфигурацию связей нейронов. Если считать различные конфигурации связей равновероятными, то для всех состояний SR равны между собой, и тогда неопределенность этих состояний равна:

Нсост= log SR= log (N.W/2) (13)

На этой основе можно сравнить максимальную неопределенность состояний отдела анализатора НM с текущей неопределенностью использования одной из связей нейронов в определенной конфигурации:

Rоа= 1 – Нсост/ Нmk (14)

При функционировании живой системы анализаторы получают информацию из внешней среды и на уровне центральных отделов мозга формируются структуры из нейронов, фиксирующие свойства и характеристики сигналов и их взаимосвязи. Создающиеся структуры отражают знания об окружающем мире, результаты обучения, опыт функционирования. Устранение неопределенности, рост организации является результатом работы сенсорных систем, адаптации и развития организма. При этом мозг разрешает неопределенности внешней и внутренней среды организма (рис. 4).

Нвнеш сенсорные системы- интеграция информации- рост организации О

Нсреды

Нвнутр -гуморальные системы, симпатическая, парасимпатическая системы

Рисунок 4- Внешняя и внутренняя среды для работы мозга

Общая неопределенность, с которой сталкивается мозг в процессе функционирования, равна сумме:

Нсреды = Нвнеш + Нвнутр (15)

Функциональная сложность не учитывает сложности выполнения функций, поэтому численно гораздо меньше сложности описания. Система с большей сложностью описания может иметь меньшую функциональную сложность.

Сложность отражают различные способы поведения, сложность выражается типом неопределенности, опытом принятия решений. Хаос – высшая сложность, а для решающих систем важен критерий F: предпочтительность выбора → решение за приемлемое время t. Внутренняя сложность => преобразование при полном использовании потенциальных возможностей St .

Накопление знаний или прирост информации определяет структурная энтропия:

dS = dI / O (16 )

где dI – прирост знаний (информации); O – уровень организации (запас знаний) dS = ?(dI, O) – неубывающая функция эволюции.

Если dl =35*105 байт/д, O =108 байт, то dS =(35*105 байт )/(108 байт)=0.035 т.е. ; прирост знаний составил 3,5% ; при dI=35.105 dS=35*105 /105 = 35, dI/ O – относительный прирост знаний организации => dS – отражение в ее структуре: dI * M = const .

Сложная система (СС) получает из среды информацию на физическом уровне и обрабатывает ее в связи с имеющимися знаниями о среде , используя мысленный контакт. На основе обработки с привлечением имеющихся знаний (прецедентов) вырабатывается реакция, которая реализуется , анализируются ее результаты и фиксируются во внутренних структурах. Эти изменения структур, рост структурной энтропии ведет к процессам сомоорганизации. Накопленная негэнтропия повышает уровень организации СС, позволяет быстрее приспособиться к внешним изменениям и накапливать опыт, обучаться (рис.5).

|

Рисунок 5- Взаимодействие сложной системы со средой |

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

Развитие системы идёт по восходящей ветви только тогда, когда растёт её функциональная сложность.

3.Результаты исследований информационных характеристик сенсорных систем

В информатике и теории алгоритмов вводится понятие вычислительной сложности алгоритма, которая определяется как зависимость объёма информационных ресурсов (памяти и быстродействия), необходимых для определённых вычислений, от размера (сложности описания) исходных данных. Применительно к системе её можно понимать, как минимальный (по множеству доступных алгоритмов) объём ресурсов, необходимый для прогнозирования состояния с заданной точностью и на определённый период времени. Будем называть этот объём внешней вычислительной сложностью системы.

Квантовая теория информации Ллойда распространяет понятие вычислительной сложности на любые физические системы в том смысле, что каждая система "вычисляет", по крайней мере, саму себя, то состояние, в которое ей следует перейти в данный момент.

сложность описания соответствует энтропии.. Поэтому наибольшей вычислительной сложностью обладают системы с большим количеством гибких связей, примером чему является человеческий мозг.

Одним из подходов к моделированию центральной нервной системы (ЦНС)является виртуальное информационное моделирование, методологические принципы которого разрабатываются сотрудниками лаборатории медицинской информатики ВЦДВО РАН [7]. Модель ЦНС ВИМ биологического объекта представляет собой созданную в результате компьютерного моделирования систему отражающей форму, внутреннюю структуру и функции биологического объекта. Технологии ВИМ основаны на теоретико-игровом подходе к задачам распознавания образов и принятия решений. Была построена упрощенная ВИМ ЦНС, включающая головной мозг (кору, белое вещество, подкорковые ядра) и спинной мозг. Модель мозга состоит из 1610 точек. Такая модель является динамической, и с ее помощью изучалось формирование биопотенциалов в разных участках головного мозга.

В.И.Шумилов [8] провел расчеты информационной емкости мозга человека на основе следующих рассуждений: срок жизни человека 100 лет (36 500 дней= 876 000 часов= 52 560 000 минут= 3 153 600 000 секунд), восприятие человека с первой секунды жизни развито максимально. Можно определить искомый объем W воспринимаемой человеком за всю жизнь информации (бит) по формуле:

(бит) по формуле:

W= V*T (17 )

W= V*T (17 )

где V- мощность потока сенсорного восприятия (бит/сек) информации человеком , V= Σ vi.n, vi- объем информации i-того сенсорного потока, n- число сенсорных каналов, Т- время жизни человека (сек). Расчеты В.И.Шумилова дают W= 3.1012 бит/жизнь [8], т.е.300-500 терабайт.

Реакция мозга на воздействие среды определяется траекторией движения по структурам мозга сигналов, порождённых воздействием среды на входные рецепторы. Для расчетов информационной емкости нейрона обозначим:– N – количество нейронов в головном мозге;– L – среднее количество входов-дендритов у одного нейрона; R – среднее количество нейронов, с выходами-аксонами которых может связаться нейрон через один из своих входов-дендритов; определяется средней длиной дендритов и аксонов, их топологией;– D – число различимых значений логического веса связи между нейронами. Сделаем естественное предположение, что информация в мозге отображается путём образования связей между нейронами головного мозга.

Примем, что выходы рецепторов анализаторов работают как двоичные элементы (1 или 0).Входы нейронов имеют различные веса, что эквивалентно различию их электрических сопротивлений, могущих изменяться со временем. На сегодня неизвестно, какова информационная ёмкость одного входа нейрона за счёт различия весов связей; количество различимых весов связи D = 4096 = 212 . То-есть информативность веса связи принимается равной 12 бит [8]. Примем, в соответствии с имеющимися на сегодня лабораторными данными, что в человеческом мозге содержится N=15 млрд нейронов (1.5·1010). У каждого из этих N нейронов имеется L=10 000 = 104 входов (в мозге человека насчитывается до 100 млрд нейронов, каждый из которых имеет до 20 000 входов-дендритов). Каждый из N нейронов посредством каждого из своих L входов-дендритов может быть связан с некоторыми L нейронами из числа R близлежащих нейронов, в том числе и с самим собой или с каким-то нейроном через несколько входов. Реакция мозга на воздействие среды определяется траекторией движения по структурам мозга сигналов, порожденных воздействями среды на рецепторы.Для расчета информационной емкости нейрона применена формула [8:

Iнейр= log2(R.D)L= L.log2 R.D (18 )

Поскольку L=104 входов, R= 100 , D= 4000 , то выражение (18 ) дает оценку:

Iнейр= log2(R.D)L= 10000.log2 400000= 10000.105,6 бит=~185 Кб

Если мозг состоит из 100 млрд нейронов, то его емкость равна:

Iмозга=2.105. 1011= 2.1016 байт= 20 петабайт,

(у В.Н.Шумилова 300 Тб, максимум 500 терабайт).Человек в среднем перерабатывает в день 74 Гб, продумывает 70000 мыслей; на этой основе за всю жизнь мозг может обработать:

Wчж= 74.109. 36500 дн= 2,7.1015 байт/жизнь=2,7 петабайта информации

А одна мысль в среднем содержит i= 74.109 / 7.104=10,6.105 байт= 1 мегабайт, что составляет структуру из примерно 50 нейронов.

Бродбент и др. рассматривали модель мозга как систему обработки информации с ограниченными возможностями, Способность мозга адаптироваться, то-есть изменять или организовывать нейронные связи и даже выращивать новые, назвали нейропластичностью.

Первичной клеткой, выполняющей преобразование стимулов внешней среды в нервные импульсы, является рецептор. Когнитивная система человека состоит из гигантского количества рецепторов. В одном только глазу их находится около 126 миллионов [4,12]: 120 миллионов палочек (рецепторов «видящих» в черно-белом) и 6 миллионов колбочек (рецепторов, «видящих» в цвете). Каждый из этих рецепторов через последовательность нейронов, называемую проводящим путем, передает информацию в центральную нервную систему (ЦНС) .В ЦНС разрозненные данные, поступающие от каждого отдельного рецептора, собираются в единую картину воспринимаемого нами мира (рис.6). ).

Рисунок 6 - Схема хранения информации в мозге

Результаты другого исследования информационной емкости сенсорных систем приведено в трехтомнике «Физиология человека» под редакцией Р.Шмидта [4]. В разделе приводится [4] следующая таблица ( из М.Циммермана ]9],(табл. 3):

Таблица 3- Информационные характеристики сенсорных систем человека

|

Сенсорная система |

Число рецепторов |

Число эффекторов |

Суммарная пропускная способность,бит/сек |

ЦНС |

Пропускная способность физического канала, бит/сек |

|

Зрение |

2.108 |

2.106 |

107 |

Обработка ЦНС |

40 |

|

Слух |

3.104 |

2.104 |

105 |

« « |

30 |

|

Осязание |

107 |

106 |

106 |

« « |

5 |

|

Вкус |

5..104 |

103 |

103 |

« « |

1 |

|

Равновесие |

7.107 |

105 |

105 |

« « |

1 |

|

Обоняние |

106 |

20 |

10 имп/сек |

« « |

Для масл.кислоты 2,4.1012молекул /1 л воздуха |

|

Боль |

107 |

10 |

250-350 имп/сек |

« « |

1 |

Складывая пропускные способности всех сенсорных систем, получена суммарная пропускную способность сенсорных каналов

W реал п п= 107 +105 +106+107 +105= 1,12.107(бит / сек).

W реал п п= 107 +105 +106+107 +105= 1,12.107(бит / сек).

За всю жизнь (100 лет) человек может получить через сенсорные каналы:

Wжизнь= 1,1201.107бит/сек. 3,1536.109 сек= 3,532.1016бит=4,415.1016 байт=4,4 петабайт

В книге «Наглядная физиология» [10] приведено описание процесса запоминания информации и схема ее обработки человеком, Авторы определили суммарный поток сенсорных данных в 109 бит/сек. [10 ] . Если учесть полный поток внешней и внутренней сенсорной информации и оценить его в

Рпсенс= 109 бит/сек

то общий объем перерабатываемой центральной нервной системой сенсорной информации составит:

Wобщ сенс= 109. 3,1536.109= 3,1536.1018 бит= 394,2 петабайт

В книге «Искусственный интеллект. Современный подход» автор, сравнивая вычислительные возможности компьютеров и головного мозга человека, приводит [11] следующую таблицу (табл. 4):

Таблица 4- Сравнение вычислительных мощностей

|

Показатели |

Человеческий мозг |

Компьютеры |

|

Вычислительные модули |

1011 нейронов |

Центральный процессор, 109 элементов |

|

Модули памяти |

1011 нейронов |

Оперативная память !010 бит |

|

Цикл обработки информации |

10-3 сек |

10-9 сек |

|

Пропускная способность |

1014 бит/сек |

1010 бит |

|

Количество обновлений памяти в сек. |

1014 |

109 |

|

Время реакции |

0,2-0,25 сек (человек) |

10-6(робот с ИИ) |

|

Технология обработки |

параллельная |

последовательная |

Автор оценивает пропускную способность мозга на микроуровне в 1014 бит/сек, при этом прохождение сигналов в нервной системе оценивается в диапазоне 0,5-120 м/сек, время одного импульса нейрона 1 мсек, т.е. в 1 сек может генерироваться 1000 потенциалов действия. При этом вся информация, хранимая человечеством, сейчас составляет 400 экзабайт (1 экзабайт=1018 байт). Человек может сохранить 295 триллионов мегабайт (т.е. 295 экзабайт). Максимальный объем информации, воспринимаемой человеком за свою жизнь :имеет оценки: 1) 4,4 Пбайт по версии трехтомника «Физиология человека»;

2)4,2 Пбайт по версии книги «Наглядная физиология», 3)по Шумилову В.Н. 300-500 терабайт, мощность потока зрительного восприятия 2,5 Мбайт / сек.

5.Расчеты сложности анализаторов

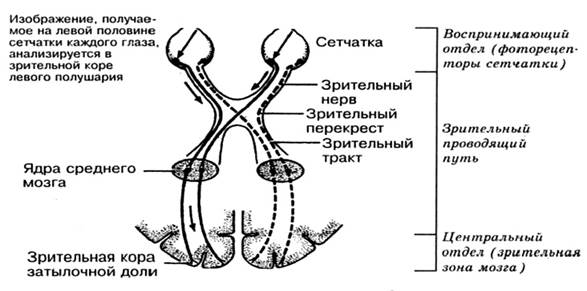

Рассмотрим организацию зрительного анализатора (рис.7).

Рисунок 7- Структура зрительного анализатора

Сетчатка глаза содержит 120.106 рецепторов- палочек и колбочек [12], при двух градациях возбуждения разнообразие состояний сетчатки равно:

Rcet= 2120/10^6, и сложность Ссетч= lg R= 0,3.120.106= 38.106 хартли или Rbit=120.106 бит= 15.106 байт. Биполярные клетки , соединенные с рецепторами, будут характеризоваться разнообразием состояний Rbp= 21,5.10^6 , сложностью Сбп = 0,3.1,5.106= 0,45.106 хартли, т.е. на этом уровне происходит сжатие информации:

Ксж1= Rcet\/Rbp= 2120.10^6/21,5.10^6=2118,5.10^6 раз.

Зрительный нерв состоит из 1 млн волокон [13] , при передаче сигнала 10 возможными состояниями он может иметь^

Rзрн =1010^6 состояний.

Сложность составит Сзрн= lg R зрн= 106 хартли , информационная емкость

I= log2 Rзрн= Rзрн/0,3= 33,3.106 бит= 4,16.106 байт.

В зрительном нерве информация также сжимается:

Ксж2= Rbp/ Rзрн= 21,5.10^6/210^6= 20,5.10^6 раз.

Нейроны наружных холмов коленчатого тела могут быть связаны с 40-200 другими клетками, что дает количество возможных структур:

Rнкт= 106.120/ 2= 60.106 структур.

Если нейрон НКТ имеет 4100 градаций весовых коэффициентов (mвннкт=4100) , то разнообразие состояний нейронов НКТ с учетом весов равно Rвннкт= 410060.10^6 = 10216.10^6 сложность Свннкт= 216.106 хартли и информационная емкость I вннкт=log2 Rвннкт= Rвннкт/0,3= 3,3.10216.10 :6 бит или 0,4.10216.10^6 байт. При учете градаций порогов нейронов НКТ (nпннкт=1000) разнообразие состояний НКТ возрастет на Rпннкт =100010^6= 103.10^6. Общее разнообразие состояний НКТ зрительной системы составит

Rобннкт= 10216.10^6.103.10^6 = 10219.10^6 состояний.

Зрительная кора содержит 500 миллионов нейронов разных типов [13, в среднем один нейрон может иметь связи с 10000 других клеток, что даст разнообразие структур, равное:

Rстнзк= 0,5.(5.108.104(= 2.1012

Аналогично предыдущему, рассчитаем разнообразие состояний нейронов зрительной коры с учетом их весов:

Rвнзрк= 103,6.+2,5.10^12

и порогов: Rпнзрк= 10005.10^8.

Общее разнообразие состояний нейронных структур зрительной коры будет равно произведению:

Rобзрк= 10155.10^8.102,5.10^12 = 102,5.10^20

Это значит, что сложность структур зрительной коры мозга вырастает на 12 порядков, ее информационная емкость имеет порядок 3 зеттабайт (3.1021 байт). Если учесть ее связи интеграции с другими областями коры мозга, эта оценка возрастет, такие показатели и характеризуют огромные возможности сенсорных систем.

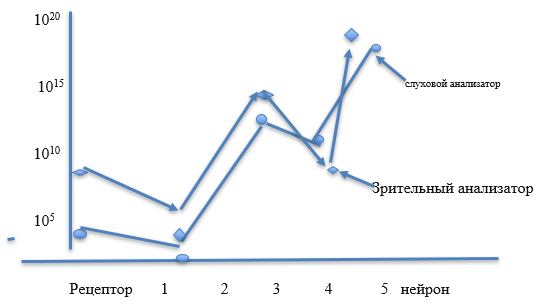

Проделаем такой же анализ информационных возможностей слуховой системы человека. Эта система работает с динамическими сигналами, их анализ носит последовательный характер, признаки выделяются на основе динамики амплитудно-частотного анализа, структура слуховой системы должна быть адаптирована под такой тип анализа.

Состояния рецептора- улитки, состоящего из 88000 волосковых клеток, имеют разнообразие:

Rулит= 288000= 1026400, сложность 26400 хартли.

Емкость рецептора 88000 бит или 11000 байт, относительно невелика, но в течение продолжительного сигнала рецептор передает большое количество данных Пи этом избыточность звуковых сигналов около 90%, что обеспечивает надежное их декодирование. Слуховой нерв состоит из 35000 волокон, имеет разнообразие 235000состояний, сложность 0,3.35000= 10550 хартли и емкость 35000 бит при бинарном кодировании. На этом этапе восприятия информации происходит ее сжатие:

Ксжсн= 1026400/1010550= 1015850раз

Кохлеарные ядра имеют 38000 нейронов и 19.107 возможных структур, при учете весов нейронных связей разнообразие состояний этих структур равно:

Rвнкя= 4100.19.10^7 ,

сложность Свнкя= 68,4.107 хартли, информационная емкость Iвнкя= 3,3.1068,4.10^7 бит (или 0,4.1068,4.10^7 байт).

С учетом порогов нейронов, считая, что ритмика нейрона может быть равна mпнкя=1000 импульсов /сек (при времени переключения 0,1 мсек), получим разнообразие состояний нейронов кохлеарных ядер:

Rпнкя =100038000= 101,14.10^5

Сложность 1,14.105 хартли и информационная емкость I= 3,3.101,14.10^5 бит или 0,4.101,14.10^5 байт.

Общее разнообразие структур кохлеарных ядер:

1011,5.10^5

Rобкя= 106,6.10^7.101,14.10^5= 107,75.10^12.

Следующее переключение нейронов слуховой системы в наружных холмах четверохолмия содержит 392000 нейронов, Rснх= 196.107 структур, разнообразие состояний которых с учетом весов связей нейронов составит:

Rвннч= 107,2.10^7,

С учетом порогов R пннх=1011,5.10^5

Общее разнообразие состояний этого переключения равно:

Rобнх= 107,2.10^7. 1011,5.10^5= 1012 состояний,

Сложность этой структуры 12 хартли, информационная емкость 3,3.1012 бит или 0,41.1012 байт. Слуховая кора содержит 10,2 миллиона нейронов, из которых могут быть сформированы Rсск= 5,1.1010структур. Эти структуры нейронов имеют разнообразие R внск= 1018,4.10^10 c учетом весов входов нейронов и Rпнск= 1010,2.10^9 состояний на основе учета порогов возбуждения. Общее разнообразие состояний слуховой коры составит :

Rобск= 1019.10 :20 состояний,

Что близко возможностям зрительной коры. Сложность слуховой коры мозга 19.1020 хартли, информационные возможности I =3.1019.10^20 бит или 0,37.101,9.10 :21= 0,5 экзабайта, что близко возможностям зрительного восприятия. Расчеты показывают, что обработка матриц зрительных изображний и динамки слуховых сигналов близки по информационной сложности [15]. График изменений разнообразий состояний отделов слухового и зрительного анализаторов приведен на рис. 8.

Разнообразие

Рисунок 8- Изменения показателей отделов анализаторов

Кожный анализатор состоит из 107рецепторов и 3 нейронов проводящих путей .Анализатор вкусов также имеет три переключения, как и вестибулярный анализатор. Расчеты информационных показателей этих анализаторов приведены в табл. 5.

Таблица 5- Информационные показатели анализаторов

|

Анализатор |

Показатель |

Рецептор |

1 нейрон |

2 нейрон |

3 нейрон |

|

|

|

Кожный |

Структуры |

2.107 |

3.106 |

5.106 |

3,75.109 |

|

|

|

|

Rвесн |

|

103.10^6 |

3,6.106 |

1010^9 |

|

|

|

|

Rпорн |

|

5.107 |

1015 |

1015.10^7 |

|

|

|

|

Rобщсети |

|

5.1013 |

3,6.1021 |

1013.10^9 |

|

|

|

|

Cложность С |

0,25.107 |

1013 |

21 hartli |

13.10^9 |

|

|

|

|

Инф.емкость |

2.107 bit |

3.1013bites |

1,5.1021 bites |

0,5.1010bites |

|

|

|

Вкусовой |

Структуры |

2.3.107 |

105 |

1,5.108 |

|

|

|

|

|

Rвесн |

|

1010^5,4 |

2,4.109 |

|

|

|

|

|

Rпорн |

|

109.10^6 |

6.105 |

|

|

|

|

|

Cложность С |

1,8.107 |

5,4.104 |

12.1014 |

|

|

|

|

|

Инф.емкость |

0,37.107 |

3,4.1014 |

0,4.1014 |

|

|

|

|

Вестибулярный |

Структуры |

1,2.107 |

4.2.106 |

5.106 |

4,7.109 |

|

|

|

|

Rвесн |

|

103.10^6 |

3,6.106 |

1010^9 |

|

|

|

|

Rпорн |

|

5.107 |

1015 |

1015.10^7 |

|

|

|

|

Rобщсети |

|

5.1013 |

3,6.1021 |

1013.10^9 |

|

|

|

|

Cложность С |

0,25.107 |

1013 |

105 hartli |

13.10^9 |

|

|

|

|

Инф.емкость |

2.107 bit |

3.1013bites |

1,5.1021bites |

0,5.1021 |

|

|

|

Запахи |

Структуры |

2.107 |

3.106 |

5.106 |

3,75.109 |

|

|

|

|

Rвесн |

|

103.10^6 |

3,6.106 |

1010^9 |

|

|

|

|

Rпорн |

|

5.107 |

1015 |

1015.10^7 |

|

|

|

|

Rобщсети |

|

5.1013 |

3,6.1021 |

1013.10^9 |

|

|

|

|

Cложность С |

0,25.107 |

1013 |

21 hartli |

13.10^9 |

|

|

|

|

Инф.емкость |

2.107 bit |

3.1013bites |

1,5.1021bites |

0,5.1010bites |

|

|

Таким образом, получены оценки основных информационных характеристик структур анализаторов.

4.Выводы.

1.Сенсорные системы человека являются многоуровневыми многоканальными системами обработки информации, имеющими огромные многообразия состояний и сложность.

2.Сложность сенсорной системы зависит от характера получаемой из внешней или внутренней среды сигналов.

3.При больших объемах информации от рецепторов (миллионы бит в сек.) сознательно воспринимается 10-40 бит/сек.

4.Деятельность человека характеризуется задержками реакции на получаемые сигналы (16 бит/сек) и инерцией, так что передаточная функция человека моделируется апериодичеким звеном с запаздыванием вида Y(p)={B/ (1+Tp)].ekt

5.Расчеты показали, что в течение жизни человек может воспринять от 300 Тб до 4 Эб информации.

6.Расчеты разнообразия состояний, сложности и информационной емкости отделов анализаторов показали закономерности сжатия информации при ее обработке в структурах анализаторов.

Библиографическая ссылка

Долятовский В.А. СЛОЖНОСТЬ ОРГАНИЗАЦИИ СЕНСОРНЫХ СИСТЕМ ЧЕЛОВЕКА: МЕРЫ И ЗАКОНОМЕРНОСТИ // Научное обозрение. Фундаментальные и прикладные исследования. 2024. № 1. ;URL: https://scientificreview.ru/ru/article/view?id=118 (дата обращения: 31.03.2026).